近日,我校人文艺术与数字媒体学院、法学院数字媒体技术专业研究生科研成果取得突破,多位研究生主导研发的成果分别被IEEE TPAMI、TVCG、ACM CHI2026等CCF-A类国际顶级期刊和会议录用,充分体现了人艺数法学院师生的科研创新能力,彰显了人艺数法在研究生培养方面的扎实工作成效。具体成果如下:

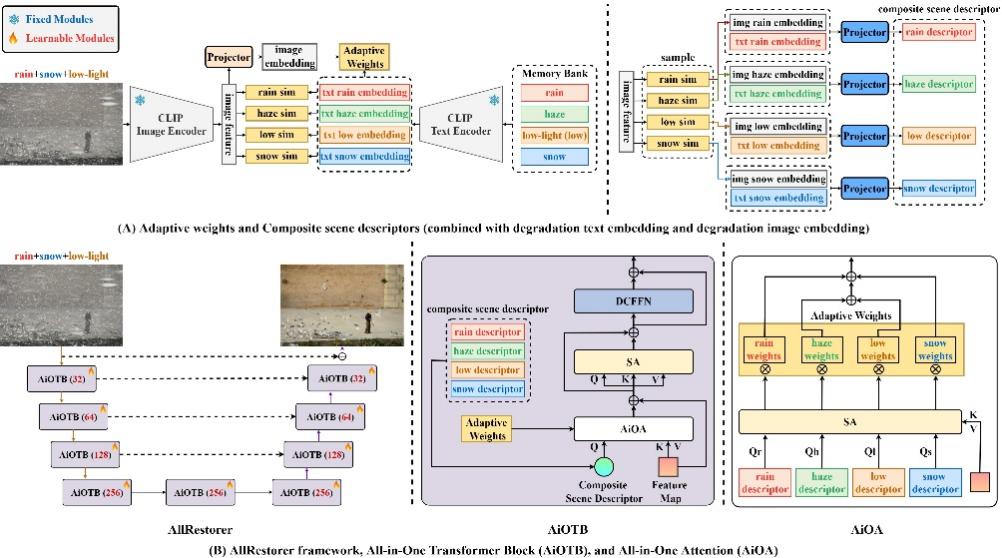

以我校数字媒体技术专业研究生毛嘉伟作为第一作者的研究成果“All-in-One Transformer for Image Restoration under Adverse Weather Degradations”被人工智能领域的国际顶级学术期刊《IEEE Transactions on Pattern Analysis and Machine Intelligence》(简称TPAMI)(中科院一区,IF= 18.6)录用。该论文的作者包括杨宇(硕士研究生)、我校数字媒体技术专业负责人尹学松教授、中国科学院大学邵岭教授和北京大学唐浩研究员。该成果面向恶劣天气条件的图像一体化复原需求,创新地提出了一种基于Transformer的多退化统一处理框架,通过设计一体化Transformer模块,能够同时处理低光照、雾霾、降雨、降雪等多种天气退化,避免了传统方法因依赖不准确的场景描述而导致的复原误差。该成果在计算机视觉与图像复原领域具有重要的学术价值,可应用于自动驾驶、视频监控、无人机航拍、遥感影像分析等实际场景,提升视觉系统在复杂天气条件下的鲁棒性与可靠性。

以我校数字媒体技术专业吴子朝副教授和研究生孙莹莹为共同第一作者的研究成果“InterMamba:Efficient Human-Human Interaction Generation with Adaptive Spatio-Temporal Mamba”被图形学与可视化领域的国际顶级学术期刊IEEE Transactions on Visualization and Computer Graphics (简称TVCG)(中科院一区,IF= 6.5)。该成果主要研究基于状态空间模型的高效人-人交互动作生成技术,提出一种名为InterMamba的自适应时空Mamba框架。采用双分支SSM结构,配合自适应时空自注意模块与交叉Mamba模块,有效融合动作序列的时空特征,实现对长序列依赖的高效建模与实时生成。实验结果表明,InterMamba在参数量仅为66M(相当于基线方法的36%)的情况下,平均推理速度提升至0.57秒(为基线方法的46%),并在多个交互数据集上达到SOTA性能。该成果对图形学、虚拟仿真与具身智能等领域具有重要的学术价值,可应用于游戏角色动画生成、虚拟人交互仿真、机器人协作行为建模等实时交互系统。

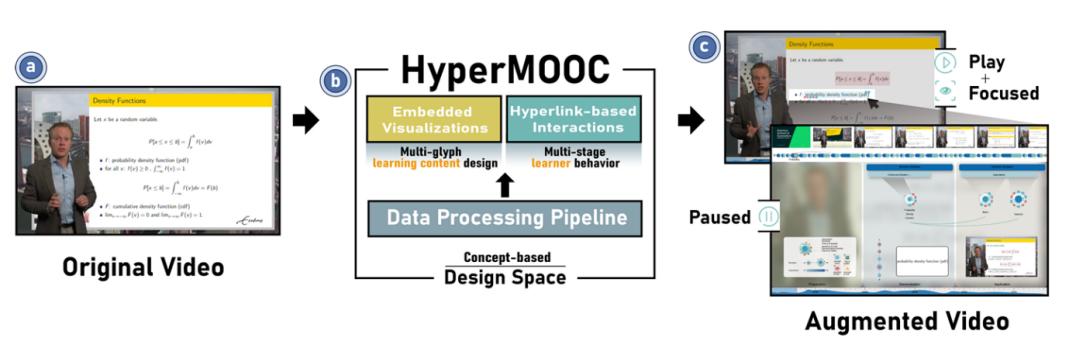

以我校数字媒体技术专业研究生叶力为第一作者的研究成果“HyperMOOC: Augmenting MOOC Videos with Concept-based Embedded Visualizations”被人机交互领域国际顶级会议ACM CHI 2026录用。该论文的通讯作者是我校人艺数法学院副院长周志光教授,由新加坡南洋理工大学的王勇教授、浙江大学陈为教授、杭州电子科技大学人艺数法学院院长王毅刚教授联合指导完成。该成果主要研究基于概念的嵌入式可视化增强技术,提出一种名为HyperMOOC的MOOC视频学习增强方法。通过构建覆盖学习内容与学习者双维度的四维设计空间,融合多符号嵌入式可视化与超链接交互机制,帮助学习者在观看视频时直观理解课程知识脉络与概念关联,从而降低认知负荷、提升学习专注度与效率。该成果对于在线教育可视化与交互学习系统设计具有重要的学术价值,可应用于大规模开放式在线课程平台、智能教育辅助工具及个性化学习路径推荐等场景,推动智慧教育向更深层次的人机协同与认知增强方向发展。

上述研究成果的取得,得益于我校对于研究生培养的高度重视和系统部署,学校始终将研究生科研创新能力培养作为核心任务,完善培养体系、搭建科研平台、优化资源保障。人艺数法学院紧扣学校部署,构建了“科研导向、平台支撑、导师引领、全程赋能”的培养模式,通过建设前沿实验室、与头部企业共建联合平台,为研究生提供一流的硬件与数据资源,并以“导师组+项目制”引导学生深度参与国家级、省部级项目,推动理论与实践结合,持续培养高素质科研创新人才。