近日,以我校管理学院(大数据与智能决策实验班)2022级本科生朱涵韬为第一作者的研究成果“Statistical Test-based Adversarial Client Detection in Federated Learning under Poisoning Attacks”被人工智能领域国际权威期刊Information Fusion接收,管理学院张忠良教授是论文的通讯作者,管理学院黄文坡副研究员是论文的合作作者,杭州电子科技大学为第一署名单位。据悉,Information Fusion期刊影响因子为15.5,是中科院一区TOP期刊。根据最新的JCR统计,其在“计算机:理论方法”类别排名第2位,在“计算机:人工智能”类别排名第4位,是人工智能领域与计算机科学的国际顶尖权威刊物,聚焦于信息融合、数据融合、知识融合等领域的研究。

论文链接:https://doi.org/10.1016/j.inffus.2025.103569

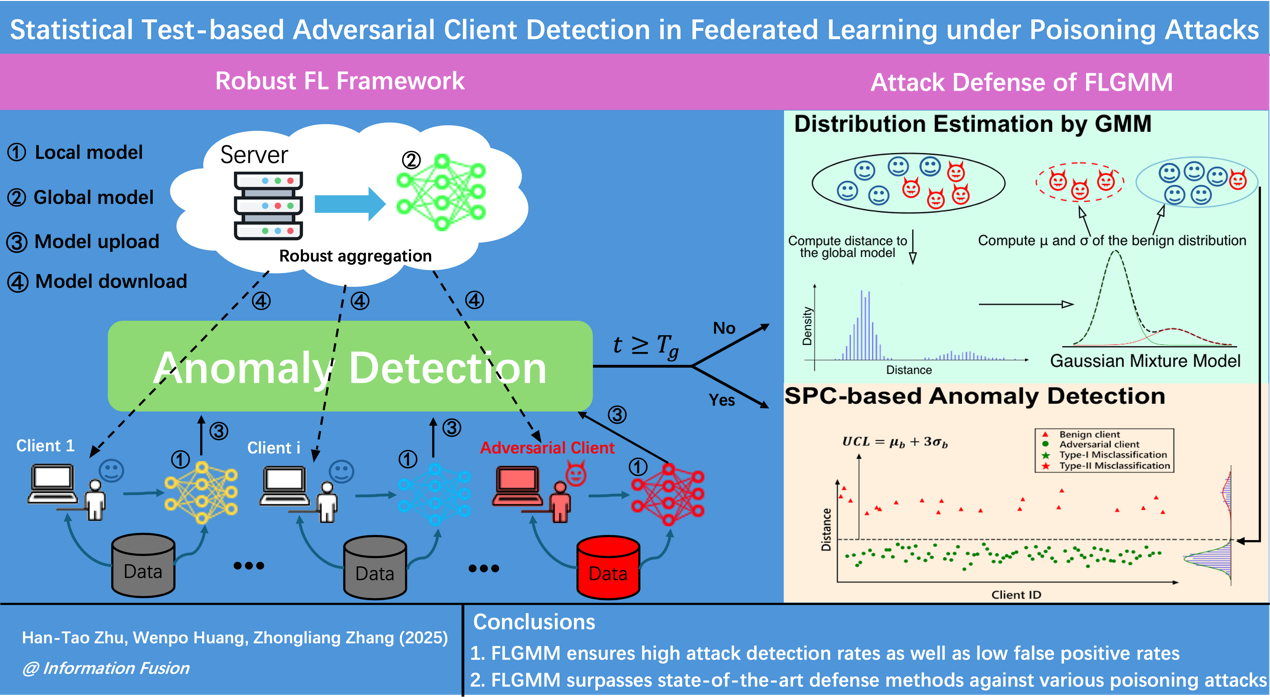

联邦学习(Federated Learning, FL)作为一种保护数据隐私的分布式机器学习范式,在AI模型联合训练中展现出巨大潜力。然而,其分布式架构使系统易受恶意投毒攻击的威胁。恶意参与方可通过上传被污染的模型更新破坏全局模型的收敛性和泛化能力,这一问题已成为制约联邦学习在相关领域应用的关键障碍。

针对安全挑战,该研究工作提出了一种名为FLGMM的基于统计控制的联邦学习恶意参与方检测方法,首次将统计过程控制理论引邦学习参与方选择领域,用以防御拜占庭投毒攻击。FLGMM主要包含分布估计、控制限建立和恶意参与方识别三个阶段。

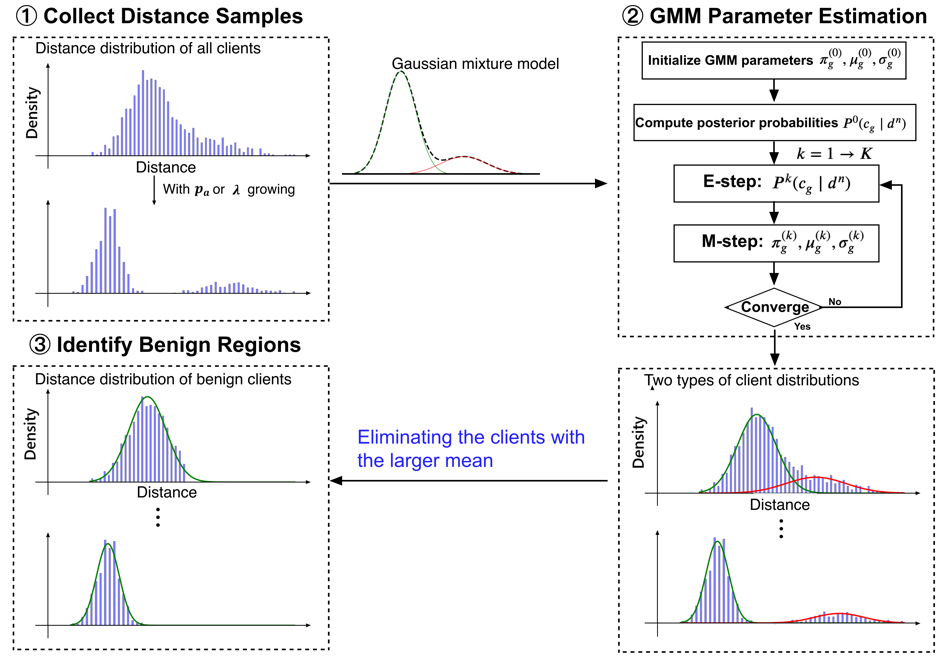

在分布估计阶段,FLGMM将参与方本地模型参数的平均作为一个鲁棒的中心模型,并计算本地模型到中心模型的L2距离作为统计监控量。FLGMM使用高斯混合模型(GMM)对参与方距离分布进行建模,估计两类参与方(良性与恶意)距离分布的均值和方差,并将均值偏移较大的一类参与方标记为潜在攻击者,将其从全局模型聚合中剔除。

分布估计阶段流程图

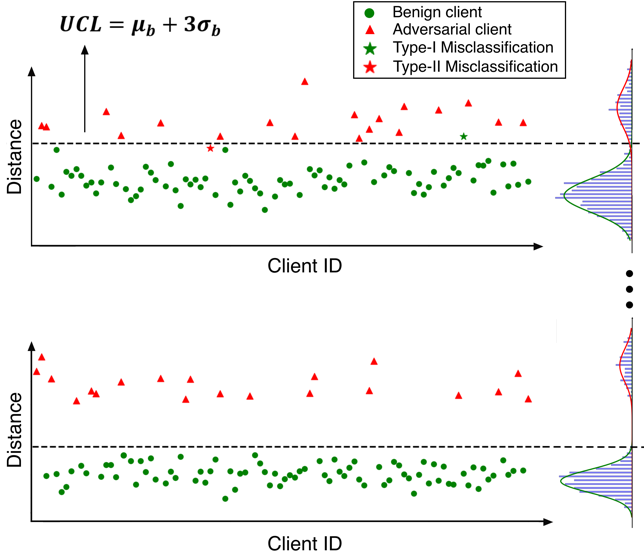

待本地训练稳定后,FLGMM进入控制限建立阶段。借助初始通讯回合中基于GMM不断完善的参与方分布参数估计,FLGMM建立了3-Sigma准则的单边控制限,在确保精准识别攻击者的同时,极大降低了良性参与方错误分类的概率(理论上0.135%的错误分类率)。借助该控制限,FLGMM在将来的通讯回合中可以高效精准的识别恶意参与方,确保联邦全局模型的精度。

基于控制图方法的参与方选择

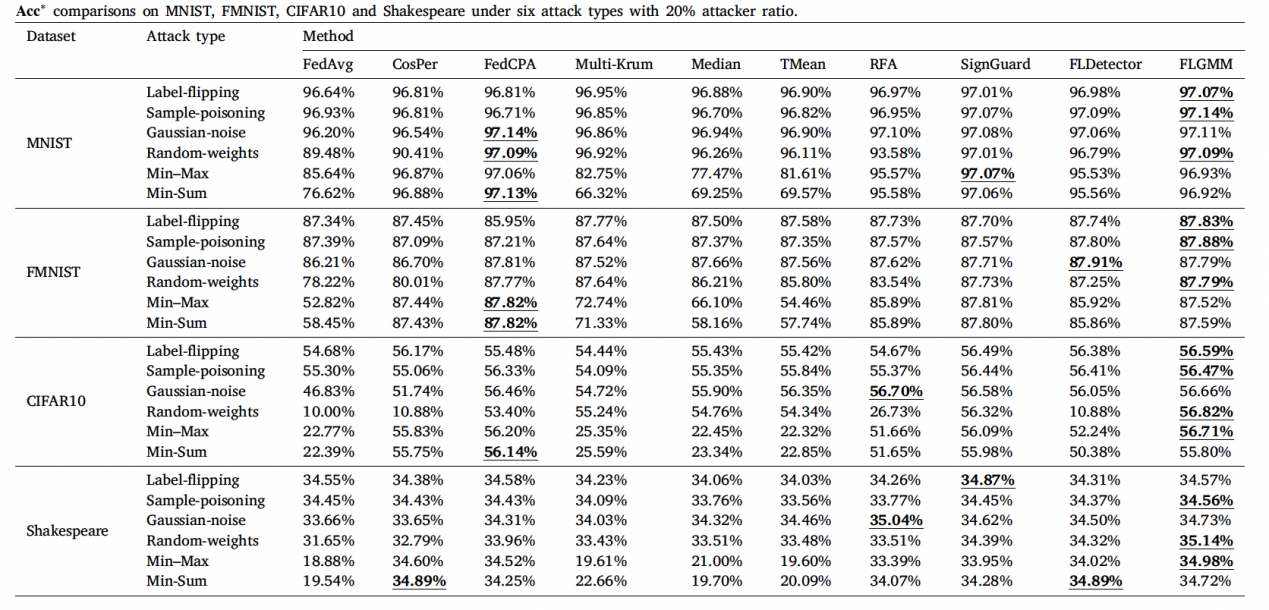

大量数值实验验证了该方法对多种攻击的防御有效性和鲁棒性,性能超过现有SOTAs。在模型投毒和数据投毒共六种攻击场景下,FLGMM的全局模型精度均超过对比的SOTAs,体现其对于各类攻击的有效防御。

本研究成果首次将统计过程控制理论系统性地引邦学习防御框架,将传统的离群点检测方法改进为对过程偏移的控制,为识别拜占庭攻击提供了新的理论视角和方法。

近年来,管理学院张忠良教授团队积极探索经管类本科生科研创新能力培养模式,已指导多名本科生在Engineering Applications of Artificial Intelligence、Neurocomputing、Pattern Recognition、International Journal of Machine Learning and Cybernetics等国际期刊发表多篇研究成果。